Corrida da IA pela saúde esbarra em falhas graves e necessidade de transparência

Enquanto OpenAI e Anthropic anunciam novas ferramentas, Google sofre com “alucinações” e informações médicas imprecisas, destacando os riscos do setor.

A OpenAI deu um passo significativo no setor de saúde com o lançamento do “OpenAI for Healthcare”, uma plataforma que inclui o ChatGPT for Healthcare, já em uso em instituições como o Boston Children’s Hospital e a UCSF. Paralelamente, a empresa apresentou o ChatGPT Health, uma experiência voltada para consumidores que permite conectar registros médicos e aplicativos de bem-estar para ajudar as pessoas a entenderem exames e se prepararem para consultas. A Anthropic também anunciou planos semelhantes para sua ferramenta Claude. Esta movimentação contrasta com a notável ausência do Google, que enfrentou sérios contratempos com suas ferramentas de IA na área médica.

A confiabilidade é o ponto crítico dessa expansão. O Google viu seu mecanismo de buscas, o AI Overviews, fornecer informações de saúde falsas e potencialmente perigosas. Uma investigação revelou que o sistema apresentou intervalos de referência incorretos para testes de função hepática, o que poderia levar pacientes gravemente doentes a acreditar, erroneamente, que estavam saudáveis. Diante da pressão, a empresa removeu os resumos automáticos para essas consultas específicas. Um estudo independente com mais de 50 mil consultas de saúde na Alemanha apontou ainda que o YouTube era a fonte mais citada pelos AI Overviews do Google, superando sites médicos e governamentais.

Problemas de “alucinações” ou confabulações da IA não se limitam aos mecanismos de busca. Em um caso documentado, o chatbot Gemini da Google inventou estudos científicos completos para embasar uma resposta sobre os resultados de uma cirurgia específica, fornecendo nomes de revistas e anos de publicação fictícios. Quando questionado, o chatbot inicialmente manteve as informações falsas antes de admitir o erro. Outro incidente envolveu um artigo de pesquisa médico-científica da Google que continha um erro anatômico, descrito pela empresa como um erro de digitação, mas que especialistas consideraram um exemplo perigoso das limitações da IA na saúde.

Consciente desses riscos, a OpenAI adotou uma postura focada em transparência e avaliação rigorosa para seu lançamento na saúde. O ChatGPT for Healthcare foi desenvolvido em colaboração com mais de 260 médicos de 60 países, que avaliaram mais de 600 mil respostas do modelo. A ferramenta é projetada para fornecer citações transparentes de fontes médicas, como estudos revisados por pares e diretrizes clínicas, e está configurada para cumprir regulamentações como a HIPAA nos EUA. A abordagem do ChatGPT Health também enfatiza que seu papel é apoiar, e não substituir, o cuidado clínico profissional.

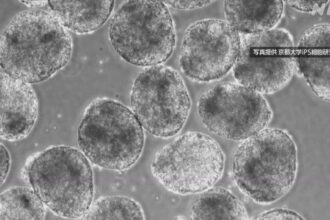

O contexto japonês oferece um paralelo relevante, onde a aplicação de IA na saúde já é uma realidade em crescimento, com foco em diagnósticos de precisão. Startups como a AI Medical Services desenvolvem sistemas que analisam imagens de endoscopia para detectar câncer com alta precisão, auxiliando médicos e reduzindo a carga de trabalho. O governo japonês também anunciou investimentos bilionários para criar hospitais movidos a inteligência artificial. Essas iniciativas destacam o potencial transformador da IA quando integrada de forma responsável e supervisionada no fluxo de trabalho clínico.

O sucesso da nova onda de ferramentas de IA na saúde, portanto, parece depender diretamente da capacidade das empresas em garantir transparência sobre a origem e a confiabilidade das informações, além de mecanismos robustos para mitigar alucinações. A experiência recente do Google serve como um alerta claro de que, neste setor, erros não são apenas bugs de software, mas podem colocar a saúde das pessoas em risco. O caminho para as empresas de IA será construir não apenas tecnologia poderosa, mas também uma confiança verificável junto a profissionais e pacientes.

Acompanhe mais atualizações no Japão em Pauta.